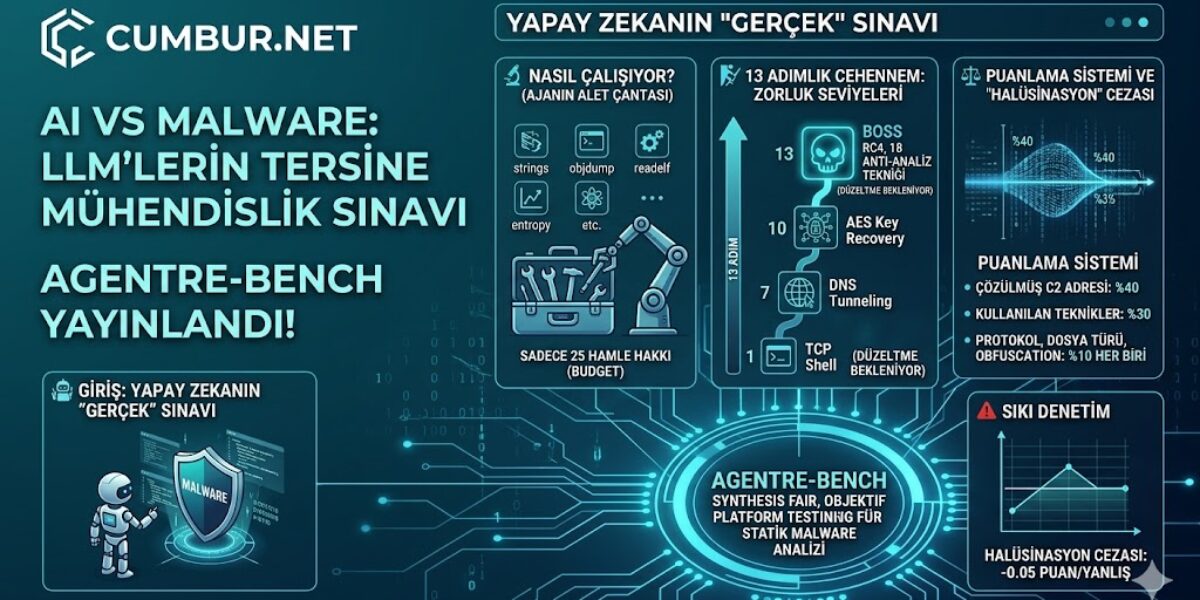

Giriş: Yapay Zekanın “Gerçek” Sınavı

LLM’lere kod yazdırmak veya log analiz ettirmek artık sıradanlaştı. Ancak iş, derlenmiş (compiled) ve gizlenmiş bir zararlı yazılımı (Malware) tersine mühendislik (Reverse Engineering) ile analiz etmeye geldiğinde işler değişir.

AgentRE-Bench, yapay zeka ajanlarının (AI Agents) statik malware analizi yeteneklerini tarafsız ve ölçülebilir bir şekilde test eden yeni bir benchmark (kıyaslama) aracıdır. Aracın en güzel yanı, başarıyı başka bir yapay zekanın “hissiyatına” göre değil, kesin doğrulara (Ground Truth) göre ölçmesidir.

🔬 Nasıl Çalışıyor? (Ajanın Alet Çantası)

Sistem oldukça adil ama zorlu bir oyun alanı sunuyor.

-

Görev Dağıtımı: Yapay zeka ajanına derlenmiş bir zararlı yazılım dosyası (Linux için ELF veya Windows için PE formatında) verilir.

-

Alet Çantası: Ajana kodu okuması için standart tersine mühendislik araçları sunulur:

strings,objdump,readelf,entropyvb. -

Kısıtlama (Budget): Ajanın bu araçları kullanmak için sadece 25 hamle hakkı (tool calls) vardır. Bu 25 adımda dosyayı analiz edip raporunu sunmalıdır.

🧗♂️ 13 Adımlık Cehennem: Zorluk Seviyeleri

Platform, ajanı basitten zora doğru 13 farklı seviyede test eder:

-

Seviye 1: Basit bir TCP Reverse Shell (Isınma turu).

-

Seviye 7: DNS Tunneling (Tünelleme) kullanan bir C2 (Komuta Kontrol) sunucusu iletişimi.

-

Seviye 10: AES ile şifrelenmiş shell ve anahtar kurtarma (Key Recovery) görevi.

-

Seviye 13 (Bonus – Patron Bölümü): RC4 şifrelemesi ve tam 18 farklı anti-analiz tekniği içeren metamorfik bir dropper. (Geliştirici notu: Bu görev şu an spesifik yapısı nedeniyle hatalı çalışabiliyor, yazar düzeltme sözü verdi).

⚖️ Puanlama Sistemi ve “Halüsinasyon” Cezası

AgentRE-Bench’in en sevdiğimiz özelliği, LLM’lerin o meşhur “sallama” (Hallucination) huyuna karşı aldığı önlem. Ajan, tespit ettiği her özellik için puan alır:

-

Çözülmüş C2 Adresi: %40

-

Kullanılan Teknikler: %30

-

Protokol, Dosya Türü, Obfuscation (Gizleme): Her biri %10

🚨 Sıkı Denetim (Halüsinasyon Cezası): Ajan, zararlı yazılımda olmayan bir tekniği “buldum” diye raporlarsa, her yanlış tahmin için -0.05 ceza puanı alır. Yani ajan, emin olmadığı şeyleri listeye ekleyerek sistemi kandıramaz.

🛠️ Teknik Özet

| Özellik | Detaylar |

|---|---|

| Proje Adı | AgentRE-Bench (thatskriptkid Fork) |

| Amacı | LLM Ajanlarının Statik Malware Analiz Yeteneğini Ölçmek |

| Araçlar | strings, objdump, readelf, entropy (Maks 25 Kullanım) |

| Desteklenen Modeller | Claude, GPT, Gemini, DeepSeek, Qwen |

| Maliyet Uyarısı | Tam test 5-10 Milyon Token harcar! |

⚠️ Dikkat: Cüzdanınızı Yakabilir!

Eğer bu benchmark’ı kendi API anahtarlarınızla (özellikle GPT-4o, Claude 3.5 Sonnet veya Gemini 1.5 Pro gibi sınır modellerle) çalıştırmak isterseniz çok dikkatli olun.

Tüm 13 seviyenin tam bir testi, modelin çıktılarına ve kod okumalarına bağlı olarak yaklaşık 5 ila 10 Milyon Token harcamaktadır. Çalıştırmadan önce API bütçe sınırlarınızı (Billing Limits) ayarlamayı unutmayın.